MapMap是一种用于快速查找的数据结构,它以键值对的形式存储数据,每一个键都是唯一的,且对应着一个值,如果想要查找Map中的数据,只需要传入一个键,Map会对键进行匹配并返回键所对应的值,可以说Map其实就是一个存放键值对的集合。Map被各种编程语言广泛使用,只不过在名称上可能会有些混淆,像Python中叫做字典(Dictionary),也有些语言称其为关联数组(Associative Array),但其实它们都是一样的,都是一个存放键值对的集合。至于Java中经常用到的HashMap也是Map的一种,它被称为散列表,关于散列表的细节我会在本文中解释HashMap的源码时提及。

Java还提供了一种与Map密切相关的数据结构:Set,它是数学意义上的集合,特性如下:

很明显,Map中的key就很符合这些特性,Set的实现其实就是在内部使用Map。例如,HashSet就定义了一个类型为HashMap的成员变量,向HashSet添加元素a,等同于向它内部的HashMap添加了一个key为a,value为一个Object对象的键值对,这个Object对象是HashSet的一个常量,它是一个虚拟值,没有什么实际含义,源码如下:

1

2

3

4

5

6

7

8

private transient HashMap<E,Object> map;

private static final Object PRESENT = new Object();

public boolean add (E e)

return map.put(e, PRESENT)==null ;

}

小插曲过后,让我们接着说Map,它是JDK的一个顶级接口,提供了三种集合视图(Collection Views):包含所有key的集合、包含所有value的集合以及包含所有键值对的集合,Map中的元素顺序与它所返回的集合视图中的元素的迭代顺序相关,也就是说,Map本身是不保证有序性的,当然也有例外,比如TreeMap就对有序性做出了保证,这主要因为它是基于红黑树实现的。

所谓的集合视图就是由集合本身提供的一种访问数据的方式,同时对视图的任何修改也会影响到集合。好比Map.keySet()返回了它包含的key的集合,如果你调用了Map.remove(key)那么keySet.contains(key)也将返回false,再比如说Arrays.asList(T)可以把一个数组封装成一个List,这样你就可以通过List的API来访问和操作这些数据,如下列示例代码:

1

2

3

4

5

6

7

String[] strings = {"a" , "b" , "c" };

List<String> list = Arrays.asList(strings);

System.out.println(list.get(0 ));

strings[0 ] = "d" ;

System.out.println(list.get(0 ));

list.set(0 , "e" );

System.out.println(strings[0 ]);

是不是感觉很神奇,其实Arrays.asList()只是将传入的数组与Arrays中的一个内部类ArrayList(注意,它与java.util包下的ArrayList不是同一个)做了一个”绑定“,在调用get()时会直接根据下标返回数组中的元素,而调用set()时也会直接修改数组中对应下标的元素。相对于直接复制来说,集合视图的优点是内存利用率更高,假设你有一个数组,又很想使用List的API来操作它,那么你不用new一个ArrayList以拷贝数组中的元素,只需要一点额外的内存(通过Arrays.ArrayList对数组进行封装),原始数据依然是在数组中的,并不会复制成多份。

Map接口规范了Map数据结构的通用API(也含有几个用于简化操作的default方法,default是JDK8的新特性,它是接口中声明的方法的默认实现,即非抽象方法)并且还在内部定义了Entry接口(键值对的实体类),在JDK中提供的所有Map数据结构都实现了Map接口,下面为Map接口的源码(代码中的注释太长了,基本都是些实现的规范,为了篇幅我就尽量省略了)。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

155

156

157

158

159

160

161

162

163

164

165

166

167

168

169

170

171

172

173

174

175

176

177

178

179

180

181

182

183

184

185

186

187

188

189

190

191

192

193

194

195

196

197

198

199

200

201

202

203

204

205

206

207

208

209

210

211

212

213

214

215

216

217

218

219

220

221

222

223

224

225

226

227

228

229

230

231

232

233

234

235

236

237

238

239

240

241

242

243

244

245

246

247

248

249

250

251

252

253

254

255

256

257

258

259

260

261

262

263

264

265

266

267

268

269

270

271

272

273

274

275

276

277

278

279

280

281

282

283

284

285

286

287

288

289

290

291

292

293

294

295

296

297

298

299

300

301

302

303

304

305

306

307

308

309

310

311

312

313

314

315

316

317

318

319

320

321

322

323

324

325

326

327

328

329

330

package java.util;

import java.util.function.BiConsumer;

import java.util.function.BiFunction;

import java.util.function.Function;

import java.io.Serializable;

public interface Map <K ,V >

* 返回这个Map中所包含的键值对的数量,如果大于Integer.MAX_VALUE,

* 则应该返回Integer.MAX_VALUE。

*/

int size ()

* Map是否为空。

*/

boolean isEmpty ()

* Map中是否包含key,如果是返回true,否则false。

*/

boolean containsKey (Object key)

* Map中是否包含value,如果是返回true,否则false。

*/

boolean containsValue (Object value)

* 根据key查找value,如果Map不包含该key,则返回null。

*/

V get (Object key) ;

* 添加一对键值对,如果Map中已含有这个key,那么新value将覆盖掉旧value,

* 并返回旧value,如果Map中之前没有这个key,那么返回null。

*/

V put (K key, V value) ;

* 删除指定key并返回之前的value,如果Map中没有该key,则返回null。

*/

V remove (Object key) ;

* 将指定Map中的所有键值对批量添加到当前Map。

*/

void putAll (Map<? extends K, ? extends V> m)

* 删除Map中所有的键值对。

*/

void clear ()

* 返回包含Map中所有key的Set,对该视图的所有修改操作会对Map产生同样的影响,反之亦然。

*/

Set<K> keySet () ;

* 返回包含Map中所有value的集合,对该视图的所有修改操作会对Map产生同样的影响,反之亦然。

*/

Collection<V> values () ;

* 返回包含Map中所有键值对的Set,对该视图的所有修改操作会对Map产生同样的影响,反之亦然。

*/

Set<Map.Entry<K, V>> entrySet();

* Entry代表一对键值对,规范了一些基本函数以及几个已实现的类函数(各种比较器)。

*/

interface Entry <K ,V >

K getKey () ;

V getValue () ;

V setValue (V value) ;

boolean equals (Object o)

int hashCode ()

public static <K extends Comparable<? super K>, V> Comparator<Map.Entry<K,V>> comparingByKey() {

return (Comparator<Map.Entry<K, V>> & Serializable)

(c1, c2) -> c1.getKey().compareTo(c2.getKey());

}

public static <K, V extends Comparable<? super V>> Comparator<Map.Entry<K,V>> comparingByValue() {

return (Comparator<Map.Entry<K, V>> & Serializable)

(c1, c2) -> c1.getValue().compareTo(c2.getValue());

}

public static <K, V> Comparator<Map.Entry<K, V>> comparingByKey(Comparator<? super K> cmp) {

Objects.requireNonNull(cmp);

return (Comparator<Map.Entry<K, V>> & Serializable)

(c1, c2) -> cmp.compare(c1.getKey(), c2.getKey());

}

public static <K, V> Comparator<Map.Entry<K, V>> comparingByValue(Comparator<? super V> cmp) {

Objects.requireNonNull(cmp);

return (Comparator<Map.Entry<K, V>> & Serializable)

(c1, c2) -> cmp.compare(c1.getValue(), c2.getValue());

}

}

* 将指定的对象与此Map进行比较是否相等。

*/

boolean equals (Object o)

* 返回此Map的hash code。

*/

int hashCode ()

* 根据key查找value,如果该key不存在或等于null则返回defaultValue。

*/

default V getOrDefault (Object key, V defaultValue)

V v;

return (((v = get(key)) != null ) || containsKey(key)) ? v : defaultValue;

}

* 遍历Map并对每个键值对执行指定的操作(action)。

* BiConsumer是一个函数接口(具有一个抽象方法的接口,用于支持Lambda),

* 它代表了一个接受两个输入参数的操作,且不返回任何结果。

* 至于它奇怪的名字,根据Java中的其他函数接口的命名规范,Bi应该是Binary的缩写,意思是二元的。

*/

default void forEach (BiConsumer<? super K, ? super V> action)

Objects.requireNonNull(action);

for (Map.Entry<K, V> entry : entrySet()) {

K k;

V v;

try {

k = entry.getKey();

v = entry.getValue();

} catch (IllegalStateException ise) {

throw new ConcurrentModificationException(ise);

}

action.accept(k, v);

}

}

* 遍历Map,然后调用传入的函数function生成新value对旧value进行替换。

* BiFunction同样是一个函数接口,它接受两个输入参数并且返回一个结果。

*/

default void replaceAll (BiFunction<? super K, ? super V, ? extends V> function)

Objects.requireNonNull(function);

for (Map.Entry<K, V> entry : entrySet()) {

K k;

V v;

try {

k = entry.getKey();

v = entry.getValue();

} catch (IllegalStateException ise) {

throw new ConcurrentModificationException(ise);

}

v = function.apply(k, v);

try {

entry.setValue(v);

} catch (IllegalStateException ise) {

throw new ConcurrentModificationException(ise);

}

}

}

* 如果指定的key不存在或者关联的value为null,则添加键值对。

*/

default V putIfAbsent (K key, V value)

V v = get(key);

if (v == null ) {

v = put(key, value);

}

return v;

}

* 当指定key关联的value与传入的参数value相等时删除该key。

*/

default boolean remove (Object key, Object value)

Object curValue = get(key);

if (!Objects.equals(curValue, value) ||

(curValue == null && !containsKey(key))) {

return false ;

}

remove(key);

return true ;

}

* 当指定key关联的value与oldValue相等时,使用newValue进行替换。

*/

default boolean replace (K key, V oldValue, V newValue)

Object curValue = get(key);

if (!Objects.equals(curValue, oldValue) ||

(curValue == null && !containsKey(key))) {

return false ;

}

put(key, newValue);

return true ;

}

* 当指定key关联到某个value时进行替换。

*/

default V replace (K key, V value)

V curValue;

if (((curValue = get(key)) != null ) || containsKey(key)) {

curValue = put(key, value);

}

return curValue;

}

* 当指定key没有关联到一个value或者value为null时,调用mappingFunction生成值并添加键值对到Map。

* Function是一个函数接口,它接受一个输入参数并返回一个结果,如果mappingFunction返回的结果

* 也为null,那么将不会调用put。

*/

default V computeIfAbsent (K key,

Function<? super K, ? extends V> mappingFunction) {

Objects.requireNonNull(mappingFunction);

V v;

if ((v = get(key)) == null ) {

V newValue;

if ((newValue = mappingFunction.apply(key)) != null ) {

put(key, newValue);

return newValue;

}

}

return v;

}

* 当指定key关联到一个value并且不为null时,调用remappingFunction生成newValue,

* 如果newValue不为null,那么进行替换,否则删除该key。

*/

default V computeIfPresent (K key,

BiFunction<? super K, ? super V, ? extends V> remappingFunction) {

Objects.requireNonNull(remappingFunction);

V oldValue;

if ((oldValue = get(key)) != null ) {

V newValue = remappingFunction.apply(key, oldValue);

if (newValue != null ) {

put(key, newValue);

return newValue;

} else {

remove(key);

return null ;

}

} else {

return null ;

}

}

* remappingFunction根据key与其相关联的value生成newValue,

* 当newValue等于null时删除该key,否则添加或者替换旧的映射。

*/

default V compute (K key,

BiFunction<? super K, ? super V, ? extends V> remappingFunction) {

Objects.requireNonNull(remappingFunction);

V oldValue = get(key);

V newValue = remappingFunction.apply(key, oldValue);

if (newValue == null ) {

if (oldValue != null || containsKey(key)) {

remove(key);

return null ;

} else {

return null ;

}

} else {

put(key, newValue);

return newValue;

}

}

* 当指定key没有关联到一个value或者value为null,将它与传入的参数value

* 进行关联。否则,调用remappingFunction生成newValue并进行替换。

* 如果,newValue等于null,那么删除该key。

*/

default V merge (K key, V value,

BiFunction<? super V, ? super V, ? extends V> remappingFunction) {

Objects.requireNonNull(remappingFunction);

Objects.requireNonNull(value);

V oldValue = get(key);

V newValue = (oldValue == null ) ? value :

remappingFunction.apply(oldValue, value);

if (newValue == null ) {

remove(key);

} else {

put(key, newValue);

}

return newValue;

}

}

需要注意一点,这些default方法都是非线程安全的,任何保证线程安全的扩展类都必须重写这些方法,例如ConcurrentHashMap。

下图为Map的继承关系结构图,它也是本文接下来将要分析的Map实现类的大纲,这些实现类都是比较常用的,在JDK中Map的实现类有几十个,大部分都是我们用不到的,限于篇幅原因就不一一讲解了(本文包含许多源码与对实现细节的分析,建议读者抽出一段连续的空闲时间静下心来慢慢阅读)。

本文作者为SylvanasSun(sylvanas.sun@gmail.com) ,首发于SylvanasSun’s Blog 。https://sylvanassun.github.io/2018/03/16/2018-03-16-map_family/

AbstractMap AbstractMap是一个抽象类,它是Map接口的一个骨架实现,最小化实现了此接口提供的抽象函数。在Java的Collection框架中基本都遵循了这一规定,骨架实现在接口与实现类之间构建了一层抽象,其目的是为了复用一些比较通用的函数以及方便扩展,例如List接口拥有骨架实现AbstractList、Set接口拥有骨架实现AbstractSet等。

下面我们按照不同的操作类型来看看AbstractMap都实现了什么,首先是查询操作:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

package java.util;

import java.util.Map.Entry;

public abstract class AbstractMap <K ,V > implements Map <K ,V >

protected AbstractMap ()

}

public int size ()

return entrySet().size();

}

public abstract Set<Entry<K,V>> entrySet();

public boolean isEmpty ()

return size() == 0 ;

}

* 遍历entrySet,然后逐个进行比较。

*/

public boolean containsValue (Object value)

Iterator<Entry<K,V>> i = entrySet().iterator();

if (value==null ) {

while (i.hasNext()) {

Entry<K,V> e = i.next();

if (e.getValue()==null )

return true ;

}

} else {

while (i.hasNext()) {

Entry<K,V> e = i.next();

if (value.equals(e.getValue()))

return true ;

}

}

return false ;

}

* 跟containsValue()同理,只不过比较的是key。

*/

public boolean containsKey (Object key)

Iterator<Map.Entry<K,V>> i = entrySet().iterator();

if (key==null ) {

while (i.hasNext()) {

Entry<K,V> e = i.next();

if (e.getKey()==null )

return true ;

}

} else {

while (i.hasNext()) {

Entry<K,V> e = i.next();

if (key.equals(e.getKey()))

return true ;

}

}

return false ;

}

* 遍历entrySet,然后根据key取出关联的value。

*/

public V get (Object key)

Iterator<Entry<K,V>> i = entrySet().iterator();

if (key==null ) {

while (i.hasNext()) {

Entry<K,V> e = i.next();

if (e.getKey()==null )

return e.getValue();

}

} else {

while (i.hasNext()) {

Entry<K,V> e = i.next();

if (key.equals(e.getKey()))

return e.getValue();

}

}

return null ;

}

}

可以发现这些操作都是依赖于函数entrySet()的,它返回了一个键值对的集合视图,由于不同的实现子类的Entry实现可能也是不同的,所以一般是在内部实现一个继承于AbstractSet且泛型为Map.Entry的内部类作为EntrySet,接下来是修改操作与批量操作:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

* 没有提供实现,子类必须重写该方法,否则调用put()会抛出异常。

*/

public V put (K key, V value)

throw new UnsupportedOperationException();

}

* 遍历entrySet,先找到目标的entry,然后删除。

*(还记得之前说过的吗,集合视图中的操作也会影响到实际数据)

*/

public V remove (Object key)

Iterator<Entry<K,V>> i = entrySet().iterator();

Entry<K,V> correctEntry = null ;

if (key==null ) {

while (correctEntry==null && i.hasNext()) {

Entry<K,V> e = i.next();

if (e.getKey()==null )

correctEntry = e;

}

} else {

while (correctEntry==null && i.hasNext()) {

Entry<K,V> e = i.next();

if (key.equals(e.getKey()))

correctEntry = e;

}

}

V oldValue = null ;

if (correctEntry !=null ) {

oldValue = correctEntry.getValue();

i.remove();

}

return oldValue;

}

* 遍历参数m,然后将每一个键值对put到该Map中。

*/

public void putAll (Map<? extends K, ? extends V> m)

for (Map.Entry<? extends K, ? extends V> e : m.entrySet())

put(e.getKey(), e.getValue());

}

* 清空entrySet等价于清空该Map。

*/

public void clear ()

entrySet().clear();

}

AbstractMap并没有实现put()函数,这样做是为了考虑到也许会有不可修改的Map实现子类继承它,而对于一个可修改的Map实现子类则必须重写put()函数。

AbstractMap没有提供entrySet()的实现,但是却提供了keySet()与values()集合视图的默认实现,它们都是依赖于entrySet()返回的集合视图实现的,源码如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

* keySet和values是lazy的,它们只会在第一次请求视图时进行初始化,

* 而且它们是无状态的,所以只需要一个实例(初始化一次)。

*/

transient Set<K> keySet;

transient Collection<V> values;

* 返回一个AbstractSet的子类,可以发现它的行为都委托给了entrySet返回的集合视图

* 与当前的AbstractMap实例,所以说它自身是无状态的。

*/

public Set<K> keySet ()

Set<K> ks = keySet;

if (ks == null ) {

ks = new AbstractSet<K>() {

public Iterator<K> iterator ()

return new Iterator<K>() {

private Iterator<Entry<K,V>> i = entrySet().iterator();

public boolean hasNext ()

return i.hasNext();

}

public K next ()

return i.next().getKey();

}

public void remove ()

i.remove();

}

};

}

public int size ()

return AbstractMap.this .size();

}

public boolean isEmpty ()

return AbstractMap.this .isEmpty();

}

public void clear ()

AbstractMap.this .clear();

}

public boolean contains (Object k)

return AbstractMap.this .containsKey(k);

}

};

keySet = ks;

}

return ks;

}

* 与keySet()基本一致,唯一的区别就是返回的是AbstractCollection的子类,

* 主要是因为value不需要保持互异性。

*/

public Collection<V> values ()

Collection<V> vals = values;

if (vals == null ) {

vals = new AbstractCollection<V>() {

public Iterator<V> iterator ()

return new Iterator<V>() {

private Iterator<Entry<K,V>> i = entrySet().iterator();

public boolean hasNext ()

return i.hasNext();

}

public V next ()

return i.next().getValue();

}

public void remove ()

i.remove();

}

};

}

public int size ()

return AbstractMap.this .size();

}

public boolean isEmpty ()

return AbstractMap.this .isEmpty();

}

public void clear ()

AbstractMap.this .clear();

}

public boolean contains (Object v)

return AbstractMap.this .containsValue(v);

}

};

values = vals;

}

return vals;

}

它还提供了两个Entry的实现类:SimpleEntry与SimpleImmutableEntry,这两个类的实现非常简单,区别也只是前者是可变的,而后者是不可变的。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

private static boolean eq (Object o1, Object o2)

return o1 == null ? o2 == null : o1.equals(o2);

}

public static class SimpleEntry <K ,V >

implements Entry <K ,V >, java .io .Serializable

{

private static final long serialVersionUID = -8499721149061103585L ;

private final K key;

private V value;

public SimpleEntry (K key, V value)

this .key = key;

this .value = value;

}

public SimpleEntry (Entry<? extends K, ? extends V> entry)

this .key = entry.getKey();

this .value = entry.getValue();

}

public K getKey ()

return key;

}

public V getValue ()

return value;

}

public V setValue (V value)

V oldValue = this .value;

this .value = value;

return oldValue;

}

public boolean equals (Object o)

if (!(o instanceof Map.Entry))

return false ;

Map.Entry<?,?> e = (Map.Entry<?,?>)o;

return eq(key, e.getKey()) && eq(value, e.getValue());

}

public int hashCode ()

return (key == null ? 0 : key.hashCode()) ^

(value == null ? 0 : value.hashCode());

}

public String toString ()

return key + "=" + value;

}

}

* 它与SimpleEntry的区别在于它是不可变的,value被final修饰,并且不支持setValue()。

*/

public static class SimpleImmutableEntry <K ,V >

implements Entry <K ,V >, java .io .Serializable

{

private static final long serialVersionUID = 7138329143949025153L ;

private final K key;

private final V value;

public SimpleImmutableEntry (K key, V value)

this .key = key;

this .value = value;

}

public SimpleImmutableEntry (Entry<? extends K, ? extends V> entry)

this .key = entry.getKey();

this .value = entry.getValue();

}

public K getKey ()

return key;

}

public V getValue ()

return value;

}

public V setValue (V value)

throw new UnsupportedOperationException();

}

public boolean equals (Object o)

if (!(o instanceof Map.Entry))

return false ;

Map.Entry<?,?> e = (Map.Entry<?,?>)o;

return eq(key, e.getKey()) && eq(value, e.getValue());

}

public int hashCode ()

return (key == null ? 0 : key.hashCode()) ^

(value == null ? 0 : value.hashCode());

}

public String toString ()

return key + "=" + value;

}

}

我们通过阅读上述的源码不难发现,AbstractMap实现的操作都依赖于entrySet()所返回的集合视图。剩下的函数就没什么好说的了,有兴趣的话可以自己去看看。

TreeMap TreeMap是基于红黑树(一种自平衡的二叉查找树)实现的一个保证有序性的Map,在继承关系结构图中可以得知TreeMap实现了NavigableMap接口,而该接口又继承了SortedMap接口,我们先来看看这两个接口定义了一些什么功能。

SortedMap 首先是SortedMap接口,实现该接口的实现类应当按照自然排序保证key的有序性,所谓自然排序即是根据key的compareTo()函数(需要实现Comparable接口)或者在构造函数中传入的Comparator实现类来进行排序,集合视图遍历元素的顺序也应当与key的顺序一致。SortedMap接口还定义了以下几个有效利用有序性的函数:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

package java.util;

public interface SortedMap <K ,V > extends Map <K ,V >

* 用于在此Map中对key进行排序的比较器,如果为null,则使用key的compareTo()函数进行比较。

*/

Comparator<? super K> comparator();

* 返回一个key的范围为从fromKey到toKey的局部视图(包括fromKey,不包括toKey,包左不包右),

* 如果fromKey和toKey是相等的,则返回一个空视图。

* 返回的局部视图同样是此Map的集合视图,所以对它的操作是会与Map互相影响的。

*/

SortedMap<K,V> subMap (K fromKey, K toKey) ;

* 返回一个严格地小于toKey的局部视图。

*/

SortedMap<K,V> headMap (K toKey) ;

* 返回一个大于或等于fromKey的局部视图。

*/

SortedMap<K,V> tailMap (K fromKey) ;

* 返回当前Map中的第一个key(最小)。

*/

K firstKey () ;

* 返回当前Map中的最后一个key(最大)。

*/

K lastKey () ;

Set<K> keySet () ;

Collection<V> values () ;

Set<Map.Entry<K, V>> entrySet();

}

NavigableMap 然后是SortedMap的子接口NavigableMap,该接口扩展了一些用于导航(Navigation)的方法,像函数lowerEntry(key)会根据传入的参数key返回一个小于key的最大的一对键值对,例如,我们如下调用lowerEntry(6),那么将返回key为5的键值对,如果没有key为5,则会返回key为4的键值对,以此类推,直到返回null(实在找不到的情况下)。

1

2

3

4

5

6

7

8

9

public static void main (String[] args)

NavigableMap<Integer, Integer> map = new TreeMap<>();

for (int i = 0 ; i < 10 ; i++)

map.put(i, i);

assert map.lowerEntry(6 ).getKey() == 5 ;

assert map.lowerEntry(5 ).getKey() == 4 ;

assert map.lowerEntry(0 ).getKey() == null ;

}

NavigableMap定义的都是一些类似于lowerEntry(key)的方法和以逆序、升序排序的集合视图,这些方法利用有序性实现了相比SortedMap接口更加灵活的操作。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

package java.util;

public interface NavigableMap <K ,V > extends SortedMap <K ,V >

* 返回一个小于指定key的最大的一对键值对,如果找不到则返回null。

*/

Map.Entry<K,V> lowerEntry (K key) ;

* 返回一个小于指定key的最大的一个key,如果找不到则返回null。

*/

K lowerKey (K key) ;

* 返回一个小于或等于指定key的最大的一对键值对,如果找不到则返回null。

*/

Map.Entry<K,V> floorEntry (K key) ;

* 返回一个小于或等于指定key的最大的一个key,如果找不到则返回null。

*/

K floorKey (K key) ;

* 返回一个大于或等于指定key的最小的一对键值对,如果找不到则返回null。

*/

Map.Entry<K,V> ceilingEntry (K key) ;

* 返回一个大于或等于指定key的最小的一个key,如果找不到则返回null。

*/

K ceilingKey (K key) ;

* 返回一个大于指定key的最小的一对键值对,如果找不到则返回null。

*/

Map.Entry<K,V> higherEntry (K key) ;

* 返回一个大于指定key的最小的一个key,如果找不到则返回null。

*/

K higherKey (K key) ;

* 返回该Map中最小的键值对,如果Map为空则返回null。

*/

Map.Entry<K,V> firstEntry () ;

* 返回该Map中最大的键值对,如果Map为空则返回null。

*/

Map.Entry<K,V> lastEntry () ;

* 返回并删除该Map中最小的键值对,如果Map为空则返回null。

*/

Map.Entry<K,V> pollFirstEntry () ;

* 返回并删除该Map中最大的键值对,如果Map为空则返回null。

*/

Map.Entry<K,V> pollLastEntry () ;

* 返回一个以当前Map降序(逆序)排序的集合视图

*/

NavigableMap<K,V> descendingMap () ;

* 返回一个包含当前Map中所有key的集合视图,该视图中的key以升序(正序)排序。

*/

NavigableSet<K> navigableKeySet () ;

* 返回一个包含当前Map中所有key的集合视图,该视图中的key以降序(逆序)排序。

*/

NavigableSet<K> descendingKeySet () ;

* 与SortedMap.subMap基本一致,区别在于多的两个参数fromInclusive和toInclusive,

* 它们代表是否包含from和to,如果fromKey与toKey相等,并且fromInclusive与toInclusive

* 都为true,那么不会返回空集合。

*/

NavigableMap<K,V> subMap (K fromKey, boolean fromInclusive,

K toKey, boolean toInclusive);

* 返回一个小于或等于(inclusive为true的情况下)toKey的局部视图。

*/

NavigableMap<K,V> headMap (K toKey, boolean inclusive) ;

* 返回一个大于或等于(inclusive为true的情况下)fromKey的局部视图。

*/

NavigableMap<K,V> tailMap (K fromKey, boolean inclusive) ;

* 等价于subMap(fromKey, true, toKey, false)。

*/

SortedMap<K,V> subMap (K fromKey, K toKey) ;

* 等价于headMap(toKey, false)。

*/

SortedMap<K,V> headMap (K toKey) ;

* 等价于tailMap(fromKey, true)。

*/

SortedMap<K,V> tailMap (K fromKey) ;

}

NavigableMap接口相对于SortedMap接口来说灵活了许多,正因为TreeMap也实现了该接口,所以在需要数据有序而且想灵活地访问它们的时候,使用TreeMap就非常合适了。

红黑树 上文我们提到TreeMap的内部实现基于红黑树,而红黑树又是二叉查找树的一种。二叉查找树是一种有序的树形结构,优势在于查找、插入的时间复杂度只有O(log n),特性如下:

尽管二叉查找树看起来很美好,但事与愿违,二叉查找树在极端情况下会变得并不是那么有效率,假设我们有一个有序的整数序列:1,2,3,4,5,6,7,8,9,10,...,如果把这个序列按顺序全部插入到二叉查找树时会发生什么呢?二叉查找树会产生倾斜,序列中的每一个元素都大于它的根节点(前一个元素),左子树永远是空的,那么这棵二叉查找树就跟一个普通的链表没什么区别了,查找操作的时间复杂度只有O(n)。

为了解决这个问题需要引入自平衡的二叉查找树,所谓自平衡,即是在树结构将要倾斜的情况下进行修正,这个修正操作被称为旋转,通过旋转操作可以让树趋于平衡。

红黑树是平衡二叉查找树的一种实现,它的名字来自于它的子节点是着色的,每个子节点非黑即红,由于只有两种颜色(两种状态),一般使用boolean来表示,下面为TreeMap中实现的Entry,它代表红黑树中的一个节点:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

private static final boolean RED = false ;

private static final boolean BLACK = true ;

* Node in the Tree. Doubles as a means to pass key-value pairs back to

* user (see Map.Entry).

*/

static final class Entry <K ,V > implements Map .Entry <K ,V >

K key;

V value;

Entry<K,V> left;

Entry<K,V> right;

Entry<K,V> parent;

boolean color = BLACK;

* Make a new cell with given key, value, and parent, and with

* {@code null} child links, and BLACK color.

*/

Entry(K key, V value, Entry<K,V> parent) {

this .key = key;

this .value = value;

this .parent = parent;

}

* Returns the key.

*

* @return the key

*/

public K getKey ()

return key;

}

* Returns the value associated with the key.

*

* @return the value associated with the key

*/

public V getValue ()

return value;

}

* Replaces the value currently associated with the key with the given

* value.

*

* @return the value associated with the key before this method was

* called

*/

public V setValue (V value)

V oldValue = this .value;

this .value = value;

return oldValue;

}

public boolean equals (Object o)

if (!(o instanceof Map.Entry))

return false ;

Map.Entry<?,?> e = (Map.Entry<?,?>)o;

return valEquals(key,e.getKey()) && valEquals(value,e.getValue());

}

public int hashCode ()

int keyHash = (key==null ? 0 : key.hashCode());

int valueHash = (value==null ? 0 : value.hashCode());

return keyHash ^ valueHash;

}

public String toString ()

return key + "=" + value;

}

}

任何平衡二叉查找树的查找操作都是与二叉查找树是一样的,因为查找操作并不会影响树的结构,也就不需要进行修正,代码如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

public V get (Object key)

Entry<K,V> p = getEntry(key);

return (p==null ? null : p.value);

}

final Entry<K,V> getEntry (Object key)

if (comparator != null )

return getEntryUsingComparator(key);

if (key == null )

throw new NullPointerException();

@SuppressWarnings ("unchecked" )

Comparable<? super K> k = (Comparable<? super K>) key;

Entry<K,V> p = root;

while (p != null ) {

int cmp = k.compareTo(p.key);

if (cmp < 0 )

p = p.left;

else if (cmp > 0 )

p = p.right;

else

return p;

}

return null ;

}

而插入和删除操作与平衡二叉查找树的细节是息息相关的,关于红黑树的实现细节,我之前写过的一篇博客红黑树的那点事儿 已经讲的很清楚了,对这方面不了解的读者建议去阅读一下,就不在这里重复叙述了。

集合视图 最后看一下TreeMap的集合视图的实现,集合视图一般都是实现了一个封装了当前实例的类,所以对集合视图的修改本质上就是在修改当前实例,TreeMap也不例外。

TreeMap的headMap()、tailMap()以及subMap()函数都返回了一个静态内部类AscendingSubMap,从名字上也能猜出来,为了支持倒序,肯定也还有一个DescendingSubMap,它们都继承于NavigableSubMap,一个继承AbstractMap并实现了NavigableMap的抽象类:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

110

111

112

113

114

115

116

117

118

119

120

121

122

123

124

125

126

127

128

129

130

131

132

133

134

135

136

137

138

139

140

141

142

143

144

145

146

147

148

149

150

151

152

153

154

abstract static class NavigableSubMap <K ,V > extends AbstractMap <K ,V >

implements NavigableMap <K ,V >, java .io .Serializable {

private static final long serialVersionUID = -2102997345730753016L ;

final TreeMap<K,V> m;

* (fromStart, lo, loInclusive) 与 (toEnd, hi, hiInclusive)代表了两个三元组,

* 如果fromStart为true,那么范围的下限(绝对)为map(被封装的TreeMap)的起始key,

* 其他值将被忽略。

* 如果loInclusive为true,lo将会被包含在范围内,否则lo是在范围外的。

* toEnd与hiInclusive与上述逻辑相似,只不过考虑的是上限。

*/

final K lo, hi;

final boolean fromStart, toEnd;

final boolean loInclusive, hiInclusive;

NavigableSubMap(TreeMap<K,V> m,

boolean fromStart, K lo, boolean loInclusive,

boolean toEnd, K hi, boolean hiInclusive) {

if (!fromStart && !toEnd) {

if (m.compare(lo, hi) > 0 )

throw new IllegalArgumentException("fromKey > toKey" );

} else {

if (!fromStart)

m.compare(lo, lo);

if (!toEnd)

m.compare(hi, hi);

}

this .m = m;

this .fromStart = fromStart;

this .lo = lo;

this .loInclusive = loInclusive;

this .toEnd = toEnd;

this .hi = hi;

this .hiInclusive = hiInclusive;

}

final boolean tooLow (Object key)

if (!fromStart) {

int c = m.compare(key, lo);

if (c < 0 || (c == 0 && !loInclusive))

return true ;

}

return false ;

}

final boolean tooHigh (Object key)

if (!toEnd) {

int c = m.compare(key, hi);

if (c > 0 || (c == 0 && !hiInclusive))

return true ;

}

return false ;

}

final boolean inRange (Object key)

return !tooLow(key) && !tooHigh(key);

}

final boolean inClosedRange (Object key)

return (fromStart || m.compare(key, lo) >= 0 )

&& (toEnd || m.compare(hi, key) >= 0 );

}

final boolean inRange (Object key, boolean inclusive)

return inclusive ? inRange(key) : inClosedRange(key);

}

* 以abs开头的函数为关系操作的绝对版本。

*/

* 获得最小的键值对:

* 如果fromStart为true,那么直接返回当前map实例的第一个键值对即可,

* 否则,先判断lo是否包含在范围内,

* 如果是,则获得当前map实例中大于或等于lo的最小的键值对,

* 如果不是,则获得当前map实例中大于lo的最小的键值对。

* 如果得到的结果e超过了范围的上限,那么返回null。

*/

final TreeMap.Entry<K,V> absLowest () {

TreeMap.Entry<K,V> e =

(fromStart ? m.getFirstEntry() :

(loInclusive ? m.getCeilingEntry(lo) :

m.getHigherEntry(lo)));

return (e == null || tooHigh(e.key)) ? null : e;

}

final TreeMap.Entry<K,V> absHighest () {

TreeMap.Entry<K,V> e =

(toEnd ? m.getLastEntry() :

(hiInclusive ? m.getFloorEntry(hi) :

m.getLowerEntry(hi)));

return (e == null || tooLow(e.key)) ? null : e;

}

final TreeMap.Entry<K,V> absCeiling (K key) {

if (tooLow(key))

return absLowest();

TreeMap.Entry<K,V> e = m.getCeilingEntry(key);

return (e == null || tooHigh(e.key)) ? null : e;

}

final TreeMap.Entry<K,V> absHigher (K key) {

if (tooLow(key))

return absLowest();

TreeMap.Entry<K,V> e = m.getHigherEntry(key);

return (e == null || tooHigh(e.key)) ? null : e;

}

final TreeMap.Entry<K,V> absFloor (K key) {

if (tooHigh(key))

return absHighest();

TreeMap.Entry<K,V> e = m.getFloorEntry(key);

return (e == null || tooLow(e.key)) ? null : e;

}

final TreeMap.Entry<K,V> absLower (K key) {

if (tooHigh(key))

return absHighest();

TreeMap.Entry<K,V> e = m.getLowerEntry(key);

return (e == null || tooLow(e.key)) ? null : e;

}

final TreeMap.Entry<K,V> absHighFence () {

return (toEnd ? null : (hiInclusive ?

m.getHigherEntry(hi) :

m.getCeilingEntry(hi)));

}

final TreeMap.Entry<K,V> absLowFence () {

return (fromStart ? null : (loInclusive ?

m.getLowerEntry(lo) :

m.getFloorEntry(lo)));

}

.....

}

一个局部视图最重要的是要能够判断出传入的key是否属于该视图的范围内,在上面的代码中可以发现NavigableSubMap提供了非常多的辅助函数用于判断范围,接下来我们看看NavigableSubMap的迭代器是如何实现的:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

102

103

104

105

106

107

108

109

* Iterators for SubMaps

*/

abstract class SubMapIterator <T > implements Iterator <T >

TreeMap.Entry<K,V> lastReturned;

TreeMap.Entry<K,V> next;

final Object fenceKey;

int expectedModCount;

SubMapIterator(TreeMap.Entry<K,V> first,

TreeMap.Entry<K,V> fence) {

expectedModCount = m.modCount;

lastReturned = null ;

next = first;

fenceKey = fence == null ? UNBOUNDED : fence.key;

}

public final boolean hasNext ()

return next != null && next.key != fenceKey;

}

final TreeMap.Entry<K,V> nextEntry () {

TreeMap.Entry<K,V> e = next;

if (e == null || e.key == fenceKey)

throw new NoSuchElementException();

if (m.modCount != expectedModCount)

throw new ConcurrentModificationException();

next = successor(e);

lastReturned = e;

return e;

}

final TreeMap.Entry<K,V> prevEntry () {

TreeMap.Entry<K,V> e = next;

if (e == null || e.key == fenceKey)

throw new NoSuchElementException();

if (m.modCount != expectedModCount)

throw new ConcurrentModificationException();

next = predecessor(e);

lastReturned = e;

return e;

}

final void removeAscending ()

if (lastReturned == null )

throw new IllegalStateException();

if (m.modCount != expectedModCount)

throw new ConcurrentModificationException();

if (lastReturned.left != null && lastReturned.right != null )

next = lastReturned;

m.deleteEntry(lastReturned);

lastReturned = null ;

expectedModCount = m.modCount;

}

final void removeDescending ()

if (lastReturned == null )

throw new IllegalStateException();

if (m.modCount != expectedModCount)

throw new ConcurrentModificationException();

m.deleteEntry(lastReturned);

lastReturned = null ;

expectedModCount = m.modCount;

}

}

final class SubMapEntryIterator extends SubMapIterator <Map .Entry <K ,V >>

SubMapEntryIterator(TreeMap.Entry<K,V> first,

TreeMap.Entry<K,V> fence) {

super (first, fence);

}

public Map.Entry<K,V> next () {

return nextEntry();

}

public void remove ()

removeAscending();

}

}

final class DescendingSubMapEntryIterator extends SubMapIterator <Map .Entry <K ,V >>

DescendingSubMapEntryIterator(TreeMap.Entry<K,V> last,

TreeMap.Entry<K,V> fence) {

super (last, fence);

}

public Map.Entry<K,V> next () {

return prevEntry();

}

public void remove ()

removeDescending();

}

}

到目前为止,我们已经针对集合视图讨论了许多,想必大家也能够理解集合视图的概念了,由于SortedMap与NavigableMap的缘故,TreeMap中的集合视图是非常多的,包括各种局部视图和不同排序的视图,有兴趣的读者可以自己去看看源码,后面的内容不会再对集合视图进行过多的解释了。

HashMap 光从名字上应该也能猜到,HashMap肯定是基于hash算法实现的,这种基于hash实现的map叫做散列表(hash table)。

散列表中维护了一个数组,数组的每一个元素被称为一个桶(bucket),当你传入一个key = "a"进行查询时,散列表会先把key传入散列(hash)函数中进行寻址,得到的结果就是数组的下标,然后再通过这个下标访问数组即可得到相关联的值。

我们都知道数组中数据的组织方式是线性的,它会直接分配一串连续的内存地址序列,要找到一个元素只需要根据下标来计算地址的偏移量即可(查找一个元素的起始地址为:数组的起始地址加上下标乘以该元素类型占用的地址大小)。因此散列表在理想的情况下,各种操作的时间复杂度只有O(1),这甚至超过了二叉查找树,虽然理想的情况并不总是满足的,关于这点之后我们还会提及。

为什么是hash? hash算法是一种可以从任何数据中提取出其“指纹”的数据摘要算法,它将任意大小的数据(输入)映射到一个固定大小的序列(输出)上,这个序列被称为hash code、数据摘要或者指纹。比较出名的hash算法有MD5、SHA。

hash是具有唯一性且不可逆的,唯一性指的是相同的输入产生的hash code永远是一样的,而不可逆也比较容易理解,数据摘要算法并不是压缩算法,它只是生成了一个该数据的摘要,没有将数据进行压缩。压缩算法一般都是使用一种更节省空间的编码规则将数据重新编码,解压缩只需要按着编码规则解码就是了,试想一下,一个几百MB甚至几GB的数据生成的hash code都只是一个拥有固定长度的序列,如果再能逆向解压缩,那么其他压缩算法该情何以堪?

我们上述讨论的仅仅是在密码学中的hash算法,而在散列表中所需要的散列函数是要能够将key寻址到buckets中的一个位置,散列函数的实现影响到整个散列表的性能。

一个完美的散列函数要能够做到均匀地将key分布到buckets中,每一个key分配到一个bucket,但这是不可能的。虽然hash算法具有唯一性,但同时它还具有重复性,唯一性保证了相同输入的输出是一致的,却没有保证不同输入的输出是不一致的,也就是说,完全有可能两个不同的key被分配到了同一个bucket(因为它们的hash code可能是相同的),这叫做碰撞冲突。总之,理想很丰满,现实很骨感,散列函数只能尽可能地减少冲突,没有办法完全消除冲突。

散列函数的实现方法非常多,一个优秀的散列函数要看它能不能将key分布均匀。首先介绍一种最简单的方法:除留余数法,先对key进行hash得到它的hash code,然后再用该hash code对buckets数组的元素数量取余,得到的结果就是bucket的下标,这种方法简单高效,也可以当做对集群进行负载均衡的路由算法。

1

2

3

4

private int hash (Key key)

return (key.hashCode() & 0x7fffffff ) % M;

}

要注意一点,只有整数才能进行取余运算,如果hash code是一个字符串或别的类型,那么你需要将它转换为整数才能使用除留余数法,不过Java在Object对象中提供了hashCode()函数,该函数返回了一个int值,所以任何你想要放入HashMap的自定义的抽象数据类型,都必须实现该函数和equals()函数,这两个函数之间也遵守着一种约定:如果a.equals(b) == true,那么a与b的hashCode()也必须是相同的。

下面为String类的hashCode()函数,它先遍历了内部的字符数组,然后在每一次循环中计算hash code(将hash code乘以一个素数并加上当前循环项的字符):

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

private final char value[];

private int hash;

public int hashCode ()

int h = hash;

if (h == 0 && value.length > 0 ) {

char val[] = value;

for (int i = 0 ; i < value.length; i++) {

h = 31 * h + val[i];

}

hash = h;

}

return h;

}

HashMap没有采用这么简单的方法,有一个原因是HashMap中的buckets数组的长度永远为一个2的幂,而不是一个素数,如果长度为素数,那么可能会更适合简单暴力的除留余数法(当然除留余数法虽然简单却并不是那么高效的),顺便一提,时代的眼泪Hashtable就使用了除留余数法,它没有强制约束buckets数组的长度。

HashMap在内部实现了一个hash()函数,首先要对hashCode()的返回值进行处理:

1

2

3

4

static final int hash (Object key)

int h;

return (key == null ) ? 0 : (h = key.hashCode()) ^ (h >>> 16 );

}

该函数将key.hashCode()的低16位和高16位做了个异或运算,其目的是为了扰乱低位的信息以实现减少碰撞冲突。之后还需要把hash()的返回值与table.length - 1做与运算(table为buckets数组),得到的结果即是数组的下标。

table.length - 1就像是一个低位掩码(这个设计也优化了扩容操作的性能),它和hash()做与操作时必然会将高位屏蔽(因为一个HashMap不可能有特别大的buckets数组,至少在不断自动扩容之前是不可能的,所以table.length - 1的大部分高位都为0),只保留低位,看似没什么毛病,但这其实暗藏玄机,它会导致总是只有最低的几位是有效的,这样就算你的hashCode()实现得再好也难以避免发生碰撞。这时,hash()函数的价值就体现出来了,它对hash code的低位添加了随机性并且混合了高位的部分特征,显著减少了碰撞冲突的发生(关于hash()函数的效果如何,可以参考这篇文章An introduction to optimising a hashing strategy )。

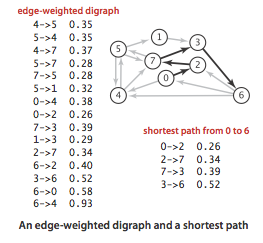

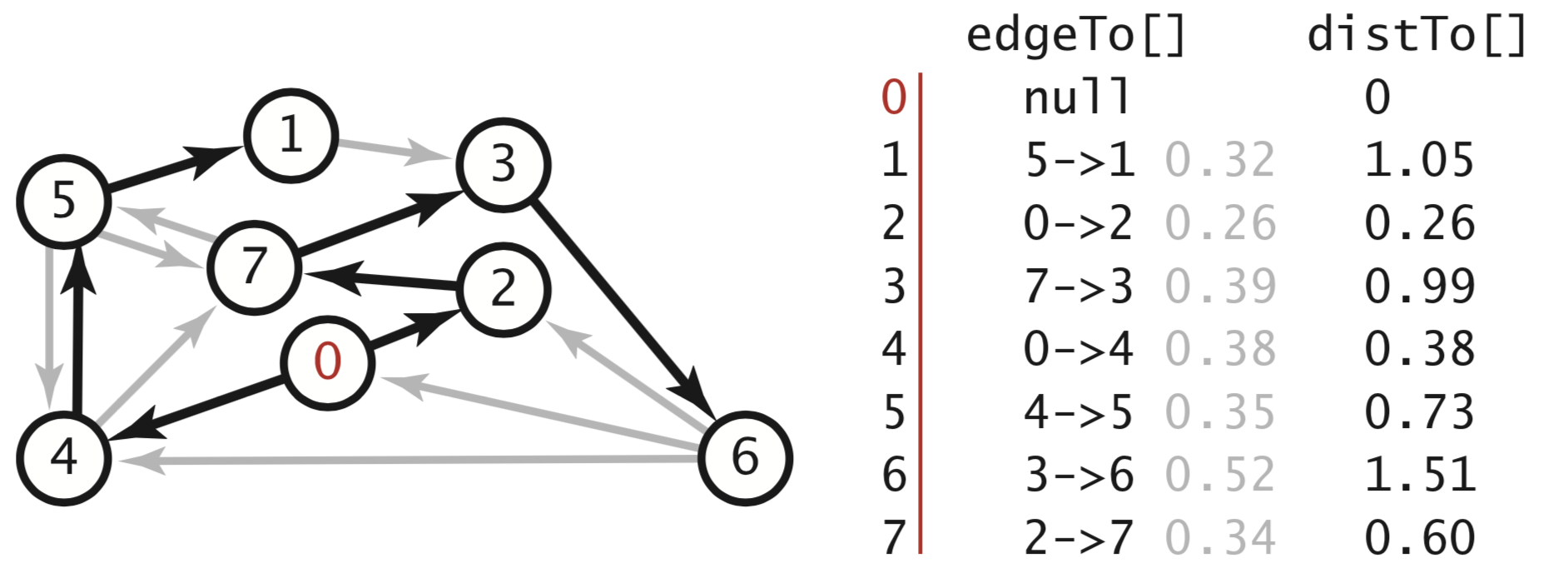

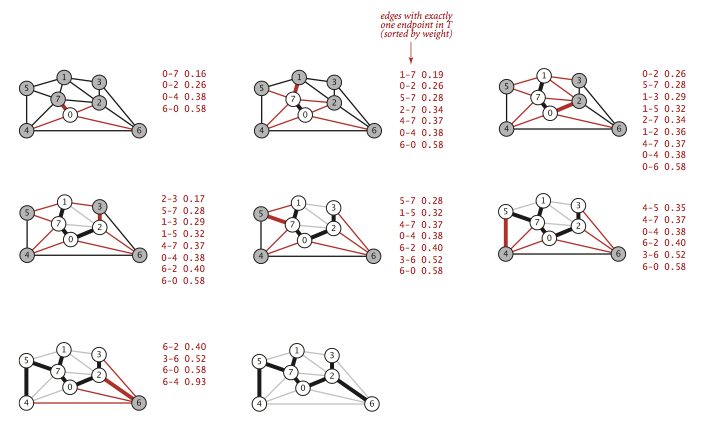

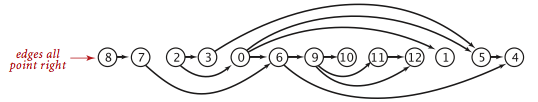

HashMap的散列函数具体流程如下图:

解决冲突 在上文中我们已经多次提到碰撞冲突,但是散列函数不可能是完美的,key分布完全均匀的情况是不存在的,所以碰撞冲突总是难以避免。

那么发生碰撞冲突时怎么办?总不能丢弃数据吧?必须要有一种合理的方法来解决这个问题,HashMap使用了叫做分离链接(Separate chaining,也有人翻译成拉链法)的策略来解决冲突。它的主要思想是每个bucket都应当是一个互相独立的数据结构,当发生冲突时,只需要把数据放入bucket中(因为bucket本身也是一个可以存放数据的数据结构),这样查询一个key所消耗的时间为访问bucket所消耗的时间加上在bucket中查找的时间。

HashMap的buckets数组其实就是一个链表数组,在发生冲突时只需要把Entry(还记得Entry吗?HashMap的Entry实现就是一个简单的链表节点,它包含了key和value以及hash code)放到链表的尾部,如果未发生冲突(位于该下标的bucket为null),那么就把该Entry做为链表的头部。而且HashMap还使用了Lazy策略,buckets数组只会在第一次调用put()函数时进行初始化,这是一种防止内存浪费的做法,像ArrayList也是Lazy的,它在第一次调用add()时才会初始化内部的数组。

不过链表虽然实现简单,但是在查找的效率上只有O(n),而且我们大部分的操作都是在进行查找,在hashCode()设计的不是非常良好的情况下,碰撞冲突可能会频繁发生,链表也会变得越来越长,这个效率是非常差的。Java 8对其实现了优化,链表的节点数量在到达阈值时会转化为红黑树,这样查找所需的时间就只有O(log n)了,阈值的定义如下:

1

2

3

4

5

6

7

8

9

* The bin count threshold for using a tree rather than list for a

* bin. Bins are converted to trees when adding an element to a

* bin with at least this many nodes. The value must be greater

* than 2 and should be at least 8 to mesh with assumptions in

* tree removal about conversion back to plain bins upon

* shrinkage.

*/

static final int TREEIFY_THRESHOLD = 8 ;

如果在插入Entry时发现一条链表超过阈值,就会执行以下的操作,对该链表进行树化;相对的,如果在删除Entry(或进行扩容)时发现红黑树的节点太少(根据阈值UNTREEIFY_THRESHOLD),也会把红黑树退化成链表。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

* 替换指定hash所处位置的链表中的所有节点为TreeNode,

* 如果buckets数组太小,就进行扩容。

*/

final void treeifyBin (Node<K,V>[] tab, int hash)

int n, index; Node<K,V> e;

if (tab == null || (n = tab.length) < MIN_TREEIFY_CAPACITY)

resize();

else if ((e = tab[index = (n - 1 ) & hash]) != null ) {

TreeNode<K,V> hd = null , tl = null ;

do {

TreeNode<K,V> p = replacementTreeNode(e, null );

if (tl == null )

hd = p;

else {

p.prev = tl;

tl.next = p;

}

tl = p;

} while ((e = e.next) != null );

if ((tab[index] = hd) != null )

hd.treeify(tab);

}

}

final void treeify (Node<K,V>[] tab)

TreeNode<K,V> root = null ;

for (TreeNode<K,V> x = this , next; x != null ; x = next) {

next = (TreeNode<K,V>)x.next;

x.left = x.right = null ;

if (root == null ) {

x.parent = null ;

x.red = false ;

root = x;

}

else {

K k = x.key;

int h = x.hash;

Class<?> kc = null ;

for (TreeNode<K,V> p = root;;) {

int dir, ph;

K pk = p.key;

if ((ph = p.hash) > h)

dir = -1 ;

else if (ph < h)

dir = 1 ;

else if ((kc == null &&

(kc = comparableClassFor(k)) == null ) ||

(dir = compareComparables(kc, k, pk)) == 0 )

dir = tieBreakOrder(k, pk);

TreeNode<K,V> xp = p;

if ((p = (dir <= 0 ) ? p.left : p.right) == null ) {

x.parent = xp;

if (dir <= 0 )

xp.left = x;

else

xp.right = x;

root = balanceInsertion(root, x);

break ;

}

}

}

}

moveRootToFront(tab, root);

}

static int tieBreakOrder (Object a, Object b)

int d;

if (a == null || b == null ||

(d = a.getClass().getName().

compareTo(b.getClass().getName())) == 0 )

d = (System.identityHashCode(a) <= System.identityHashCode(b) ?

-1 : 1 );

return d;

}

解决碰撞冲突的另一种策略叫做开放寻址法(Open addressing),它与分离链接法的思想截然不同。在开放寻址法中,所有Entry都会存储在buckets数组,一个明显的区别是,分离链接法中的每个bucket都是一个链表或其他的数据结构,而开放寻址法中的每个bucket就仅仅只是Entry本身。

开放寻址法是基于数组中的空位来解决冲突的,它的想法很简单,与其使用链表等数据结构,不如直接在数组中留出空位来当做一个标记,反正都要占用额外的内存。

当你查找一个key的时候,首先会从起始位置(通过散列函数计算出的数组索引)开始,不断检查当前bucket是否为目标Entry(通过比较key来判断),如果当前bucket不是目标Entry,那么就向后查找(查找的间隔取决于实现),直到碰见一个空位(null),这代表你想要找的key不存在。

如果你想要put一个全新的Entry(Map中没有这个key存在),依然会从起始位置开始进行查找,如果起始位置不是空的,则代表发生了碰撞冲突,只好不断向后查找,直到发现一个空位。

开放寻址法的名字也是来源于此,一个Entry的位置并不是完全由hash值决定的,所以也叫做Closed hashing,相对的,分离链接法也被称为Open hashing或Closed addressing。

根据向后探测(查找)的算法不同,开放寻址法有多种不同的实现,我们介绍一种最简单的算法:线性探测法(Linear probing),在发生碰撞时,简单地将索引加一,如果到达了数组的尾部就折回到数组的头部,直到找到目标或一个空位。

基于线性探测法的查找操作如下:

1

2

3

4

5

6

7

8

9

10

11

12

private K[] keys;

private V[] vals;

public V get (K key)

for (int i = hash(key); keys[i] != null ; i = (i + 1 ) % m) {

if (keys[i].equals(key))

return vals[i];

}

return null ;

}

插入操作稍微麻烦一些,需要在插入之前判断当前数组的剩余容量,然后决定是否扩容。数组的剩余容量越多,代表Entry之间的间隔越大以及越早碰见空位(向后探测的次数就越少),效率自然就会变高。代价就是额外消耗的内存较多,这也是在用空间换取时间。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

public void put (K key, V value)

if (n >= m / 2 ) resize(2 * m);

int i;

for (i = hash(key); keys[i] != null ; i = (i + 1 ) % m) {

if (keys[i].equals(key)) {

vals[i] = value;

return ;

}

}

keys[i] = key;

vals[i] = value;

n++;

}

接下来是删除操作,需要注意一点,我们不能简单地把目标key所在的位置(keys和vals数组)设置为null,这样会导致此位置之后的Entry无法被探测到,所以需要将目标右侧的所有Entry重新插入到散列表中:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

public V delete (K key)

int i = hash(key);

while (!key.equals(keys[i])) {

i = (i + 1 ) % m;

}

V oldValue = vals[i];

keys[i] = null ;

vals[i] = null ;

i = (i + 1 ) % m;

while (keys[i] != null ) {

K keyToRehash = keys[i];

V valToRehash = vals[i];

keys[i] = null ;

vals[i] = null ;

n--;

put(keyToRehash, valToRehash);

i = (i + 1 ) % m;

}

n--;

if (n > 0 && n <= m / 8 ) resize(m / 2 );

return oldValue;

}

动态扩容 散列表以数组的形式组织bucket,问题在于数组是静态分配的,为了保证查找的性能,需要在Entry数量大于一个临界值时进行扩容,否则就算散列函数的效果再好,也难免产生碰撞。

所谓扩容,其实就是用一个容量更大(在原容量上乘以二)的数组来替换掉当前的数组,这个过程需要把旧数组中的数据重新hash到新数组,所以扩容也能在一定程度上减缓碰撞。

HashMap通过负载因子(Load Factor)乘以buckets数组的长度来计算出临界值,算法:threshold = load_factor * capacity。比如,HashMap的默认初始容量为16(capacity = 16),默认负载因子为0.75(load_factor = 0.75),那么临界值就为threshold = 0.75 * 16 = 12,只要Entry的数量大于12,就会触发扩容操作。

还可以通过下列的构造函数来自定义负载因子,负载因子越小查找的性能就会越高,但同时额外占用的内存就会越多,如果没有特殊需要不建议修改默认值。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

* 可以发现构造函数中根本就没初始化buckets数组。

* (之前说过buckets数组会推迟到第一次调用put()时进行初始化)

*/

public HashMap (int initialCapacity, float loadFactor)

if (initialCapacity < 0 )

throw new IllegalArgumentException("Illegal initial capacity: " +

initialCapacity);

if (initialCapacity > MAXIMUM_CAPACITY)

initialCapacity = MAXIMUM_CAPACITY;

if (loadFactor <= 0 || Float.isNaN(loadFactor))

throw new IllegalArgumentException("Illegal load factor: " +

loadFactor);

this .loadFactor = loadFactor;

this .threshold = tableSizeFor(initialCapacity);

}

buckets数组的大小约束对于整个HashMap都至关重要,为了防止传入一个不是2次幂的整数,必须要有所防范。tableSizeFor()函数会尝试修正一个整数,并转换为离该整数最近的2次幂。

1

2

3

4

5

6

7

8

9

10

11

12

* Returns a power of two size for the given target capacity.

*/

static final int tableSizeFor (int cap)

int n = cap - 1 ;

n |= n >>> 1 ;

n |= n >>> 2 ;

n |= n >>> 4 ;

n |= n >>> 8 ;

n |= n >>> 16 ;

return (n < 0 ) ? 1 : (n >= MAXIMUM_CAPACITY) ? MAXIMUM_CAPACITY : n + 1 ;

}

还记得数组索引的计算方法吗?index = (table.length - 1) & hash,这其实是一种优化手段,由于数组的大小永远是一个2次幂,在扩容之后,一个元素的新索引要么是在原位置,要么就是在原位置加上扩容前的容量。这个方法的巧妙之处全在于&运算,之前提到过&运算只会关注n - 1(n = 数组长度)的有效位,当扩容之后,n的有效位相比之前会多增加一位(n会变成之前的二倍,所以确保数组长度永远是2次幂很重要),然后只需要判断hash在新增的有效位的位置是0还是1就可以算出新的索引位置,如果是0,那么索引没有发生变化,如果是1,索引就为原索引加上扩容前的容量。

这样在每次扩容时都不用重新计算hash,省去了不少时间,而且新增有效位是0还是1是带有随机性的,之前两个碰撞的Entry又有可能在扩容时再次均匀地散布开。下面是resize()的源码:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

72

73

74

75

76

77

78

79

80

81

82

83

84

85

86

87

88

89

90

91

92

93

94

95

96

97

98

99

100

101

final Node<K,V>[] resize() {

Node<K,V>[] oldTab = table;

int oldCap = (oldTab == null ) ? 0 : oldTab.length;

int oldThr = threshold;

int newCap, newThr = 0 ;

if (oldCap > 0 ) {

if (oldCap >= MAXIMUM_CAPACITY) {

threshold = Integer.MAX_VALUE;

return oldTab;

}

else if ((newCap = oldCap << 1 ) < MAXIMUM_CAPACITY &&

oldCap >= DEFAULT_INITIAL_CAPACITY)

newThr = oldThr << 1 ;

}

else if (oldThr > 0 )

newCap = oldThr;

else {

newCap = DEFAULT_INITIAL_CAPACITY;

newThr = (int )(DEFAULT_LOAD_FACTOR * DEFAULT_INITIAL_CAPACITY);

}

if (newThr == 0 ) {

float ft = (float )newCap * loadFactor;

newThr = (newCap < MAXIMUM_CAPACITY && ft < (float )MAXIMUM_CAPACITY ?

(int )ft : Integer.MAX_VALUE);

}

threshold = newThr;

@SuppressWarnings ({"rawtypes" ,"unchecked" })

Node<K,V>[] newTab = (Node<K,V>[])new Node[newCap];

table = newTab;

if (oldTab != null ) {

for (int j = 0 ; j < oldCap; ++j) {

Node<K,V> e;

if ((e = oldTab[j]) != null ) {

oldTab[j] = null ;

if (e.next == null )

newTab[e.hash & (newCap - 1 )] = e;

else if (e instanceof TreeNode)

((TreeNode<K,V>)e).split(this , newTab, j, oldCap);

else {

Node<K,V> loHead = null , loTail = null ;

Node<K,V> hiHead = null , hiTail = null ;

Node<K,V> next;

do {

next = e.next;

if ((e.hash & oldCap) == 0 ) {

if (loTail == null )

loHead = e;

else

loTail.next = e;

loTail = e;

}

else {

if (hiTail == null )

hiHead = e;

else

hiTail.next = e;

hiTail = e;

}

} while ((e = next) != null );

if (loTail != null ) {

loTail.next = null ;

newTab[j] = loHead;

}

if (hiTail != null ) {

hiTail.next = null ;

newTab[j + oldCap] = hiHead;

}

}

}

}

}

return newTab;

}

使用HashMap时还需要注意一点,它不会动态地进行缩容,也就是说,你不应该保留一个已经删除过大量Entry的HashMap(如果不打算继续添加元素的话),此时它的buckets数组经过多次扩容已经变得非常大了,这会占用非常多的无用内存,这样做的好处是不用多次对数组进行扩容或缩容操作。不过一般也不会出现这种情况,如果遇见了,请毫不犹豫地丢掉它,或者把数据转移到一个新的HashMap。

添加元素 我们已经了解了HashMap的内部实现与工作原理,它在内部维护了一个数组,每一个key都会经过散列函数得出在数组的索引,如果两个key的索引相同,那么就使用分离链接法解决碰撞冲突,当Entry的数量大于临界值时,对数组进行扩容。

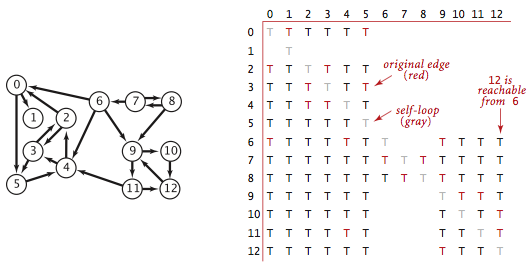

接下来以一个添加元素(put())的过程为例来梳理一下知识,下图是put()函数的流程图:

然后是源码:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

public V put (K key, V value)

return putVal(hash(key), key, value, false , true );

}

final V putVal (int hash, K key, V value, boolean onlyIfAbsent,

boolean evict) {

Node<K,V>[] tab; Node<K,V> p; int n, i;

if ((tab = table) == null || (n = tab.length) == 0 )

n = (tab = resize()).length;

if ((p = tab[i = (n - 1 ) & hash]) == null )

tab[i] = newNode(hash, key, value, null );

else {

Node<K,V> e; K k;

if (p.hash == hash &&

((k = p.key) == key || (key != null && key.equals(k))))

e = p;

else if (p instanceof TreeNode)

e = ((TreeNode<K,V>)p).putTreeVal(this , tab, hash, key, value);

else {

for (int binCount = 0 ; ; ++binCount) {

if ((e = p.next) == null ) {

p.next = newNode(hash, key, value, null );

if (binCount >= TREEIFY_THRESHOLD - 1 )

treeifyBin(tab, hash);

break ;

}

if (e.hash == hash &&

((k = e.key) == key || (key != null && key.equals(k))))

break ;

p = e;

}

}

if (e != null ) {

V oldValue = e.value;

if (!onlyIfAbsent || oldValue == null )

e.value = value;

afterNodeAccess(e);

return oldValue;

}

}

++modCount;

if (++size > threshold)

resize();

afterNodeInsertion(evict);

return null ;

}

WeakHashMap WeakHashMap是一个基于Map接口实现的散列表,实现细节与HashMap类似(都有负载因子、散列函数等等,但没有HashMap那么多优化手段),它的特殊之处在于每个key都是一个弱引用。

首先我们要明白什么是弱引用,Java将引用分为四类(从JDK1.2开始),强度依次逐渐减弱:

强引用: 就是平常使用的普通引用对象,例如Object obj = new Object(),这就是一个强引用,强引用只要还存在,就不会被垃圾收集器回收。

软引用: 软引用表示一个还有用但并非必需的对象,不像强引用,它还需要通过SoftReference类来间接引用目标对象(除了强引用都是如此)。被软引用关联的对象,在将要发生内存溢出异常之前,会被放入回收范围之中以进行第二次回收(如果第二次回收之后依旧没有足够的内存,那么就会抛出OOM异常)。

弱引用: 同样是表示一个非必需的对象,但要比软引用的强度还要弱,需要通过WeakReference类来间接引用目标对象。被弱引用关联的对象只能存活到下一次垃圾回收发生之前,当触发垃圾回收时,无论当前内存是否足够,都会回收掉只被弱引用关联的对象(如果这个对象还被强引用所引用,那么就不会被回收)。

虚引用: 这是一种最弱的引用关系,需要通过PhantomReference类来间接引用目标对象。一个对象是否有虚引用的存在,完全不会对其生存时间构成影响,也无法通过虚引用来获得对象实例。虚引用的唯一作用就是能在这个对象被回收时收到一个系统通知(结合ReferenceQueue使用)。基于这点可以通过虚引用来实现对象的析构函数,这比使用finalize()函数是要靠谱多了。

WeakHashMap适合用来当做一个缓存来使用。假设你的缓存系统是基于强引用实现的,那么你就必须以手动(或者用一条线程来不断轮询)的方式来删除一个无效的缓存项,而基于弱引用实现的缓存项只要没被其他强引用对象关联,就会被直接放入回收队列。

需要注意的是,只有key是被弱引用关联的,而value一般都是一个强引用对象。因此,需要确保value没有关联到它的key,否则会对key的回收产生阻碍。在极端的情况下,一个value对象A引用了另一个key对象D,而与D相对应的value对象C又反过来引用了与A相对应的key对象B,这就会产生一个引用循环,导致D与B都无法被正常回收。想要解决这个问题,就只能把value也变成一个弱引用,例如m.put(key, new WeakReference(value)),弱引用之间的互相引用不会产生影响。

查找操作的实现跟HashMap相比简单了许多,只要读懂了HashMap,基本都能看懂,源码如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

* Value representing null keys inside tables.

*/

private static final Object NULL_KEY = new Object();

* Use NULL_KEY for key if it is null.

*/

private static Object maskNull (Object key)

return (key == null ) ? NULL_KEY : key;

}

* Returns index for hash code h.

*/

private static int indexFor (int h, int length)

return h & (length-1 );

}

public V get (Object key)

Object k = maskNull(key);

int h = hash(k);

Entry<K,V>[] tab = getTable();

int index = indexFor(h, tab.length);

Entry<K,V> e = tab[index];

while (e != null ) {

if (e.hash == h && eq(k, e.get()))

return e.value;

e = e.next;

}

return null ;

}

尽管key是一个弱引用,但仍需手动地回收那些已经无效的Entry。这个操作会在getTable()函数中执行,不管是查找、添加还是删除,都需要调用getTable()来获得buckets数组,所以这是种防止内存泄漏的被动保护措施。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

* The table, resized as necessary. Length MUST Always be a power of two.

*/

Entry<K,V>[] table;

* Reference queue for cleared WeakEntries

*/

private final ReferenceQueue<Object> queue = new ReferenceQueue<>();

* Expunges stale entries from the table.

*/

private void expungeStaleEntries ()

for (Object x; (x = queue.poll()) != null ; ) {

synchronized (queue) {

@SuppressWarnings ("unchecked" )

Entry<K,V> e = (Entry<K,V>) x;

int i = indexFor(e.hash, table.length);

Entry<K,V> prev = table[i];

Entry<K,V> p = prev;

while (p != null ) {

Entry<K,V> next = p.next;

if (p == e) {

if (prev == e)

table[i] = next;

else

prev.next = next;

e.value = null ;

size--;

break ;

}

prev = p;

p = next;

}

}

}

}

* Returns the table after first expunging stale entries.

*/

private Entry<K,V>[] getTable() {

expungeStaleEntries();

return table;

}

然后是插入操作与删除操作,实现都比较简单:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

public V put (K key, V value)

Object k = maskNull(key);

int h = hash(k);

Entry<K,V>[] tab = getTable();

int i = indexFor(h, tab.length);

for (Entry<K,V> e = tab[i]; e != null ; e = e.next) {

if (h == e.hash && eq(k, e.get())) {

V oldValue = e.value;

if (value != oldValue)

e.value = value;

return oldValue;

}

}

modCount++;

Entry<K,V> e = tab[i];

tab[i] = new Entry<>(k, value, queue, h, e);

if (++size >= threshold)

resize(tab.length * 2 );

return null ;

}

public V remove (Object key)

Object k = maskNull(key);

int h = hash(k);

Entry<K,V>[] tab = getTable();

int i = indexFor(h, tab.length);

Entry<K,V> prev = tab[i];

Entry<K,V> e = prev;

while (e != null ) {

Entry<K,V> next = e.next;

if (h == e.hash && eq(k, e.get())) {

modCount++;

size--;

if (prev == e)

tab[i] = next;

else

prev.next = next;

return e.value;

}

prev = e;

e = next;

}

return null ;

}

我们并没有在put()函数中发现key被转换成弱引用,这是怎么回事?key只有在第一次被放入buckets数组时才需要转换成弱引用,也就是new Entry<>(k, value, queue, h, e),WeakHashMap的Entry实现其实就是WeakReference的子类。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

* The entries in this hash table extend WeakReference, using its main ref

* field as the key.

*/

private static class Entry <K ,V > extends WeakReference <Object > implements Map .Entry <K ,V >

V value;

final int hash;

Entry<K,V> next;

* Creates new entry.

*/

Entry(Object key, V value,

ReferenceQueue<Object> queue,

int hash, Entry<K,V> next) {

super (key, queue);

this .value = value;

this .hash = hash;

this .next = next;

}

@SuppressWarnings ("unchecked" )

public K getKey ()

return (K) WeakHashMap.unmaskNull(get());

}

public V getValue ()

return value;

}

public V setValue (V newValue)

V oldValue = value;

value = newValue;

return oldValue;

}

public boolean equals (Object o)

if (!(o instanceof Map.Entry))

return false ;

Map.Entry<?,?> e = (Map.Entry<?,?>)o;

K k1 = getKey();

Object k2 = e.getKey();

if (k1 == k2 || (k1 != null && k1.equals(k2))) {

V v1 = getValue();

Object v2 = e.getValue();

if (v1 == v2 || (v1 != null && v1.equals(v2)))

return true ;

}

return false ;

}

public int hashCode ()

K k = getKey();

V v = getValue();

return Objects.hashCode(k) ^ Objects.hashCode(v);

}

public String toString ()

return getKey() + "=" + getValue();

}

}

有关使用WeakReference的一个典型案例是ThreadLocal,感兴趣的读者可以参考我之前写的博客聊一聊Spring中的线程安全性 。

LinkedHashMap LinkedHashMap继承HashMap并实现了Map接口,同时具有可预测的迭代顺序(按照插入顺序排序)。它与HashMap的不同之处在于,维护了一条贯穿其全部Entry的双向链表(因为额外维护了链表的关系,性能上要略差于HashMap,不过集合视图的遍历时间与元素数量成正比,而HashMap是与buckets数组的长度成正比的),可以认为它是散列表与链表的结合。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

* The head (eldest) of the doubly linked list.

*/

transient LinkedHashMap.Entry<K,V> head;

* The tail (youngest) of the doubly linked list.

*/

transient LinkedHashMap.Entry<K,V> tail;

* 迭代顺序模式的标记位,如果为true,采用访问排序,否则,采用插入顺序

* 默认插入顺序(构造函数中默认设置为false)

*/

final boolean accessOrder;

* Constructs an empty insertion-ordered <tt>LinkedHashMap</tt> instance

* with the default initial capacity (16) and load factor (0.75).

*/

public LinkedHashMap ()

super ();

accessOrder = false ;

}

LinkedHashMap的Entry实现也继承自HashMap,只不过多了指向前后的两个指针。

1

2

3

4

5

6

7

8

9

* HashMap.Node subclass for normal LinkedHashMap entries.

*/

static class Entry <K ,V > extends HashMap .Node <K ,V >

Entry<K,V> before, after;

Entry(int hash, K key, V value, Node<K,V> next) {

super (hash, key, value, next);

}

}

你也可以通过构造函数来构造一个迭代顺序为访问顺序(accessOrder设为true)的LinkedHashMap,这个访问顺序指的是按照最近被访问的Entry的顺序进行排序(从最近最少访问到最近最多访问)。基于这点可以简单实现一个采用LRU(Least Recently Used)策略的缓存。

1

2

3

4

5

6

public LinkedHashMap (int initialCapacity,

float loadFactor,

boolean accessOrder) {

super (initialCapacity, loadFactor);

this .accessOrder = accessOrder;

}

LinkedHashMap复用了HashMap的大部分代码,所以它的查找实现是非常简单的,唯一稍微复杂点的操作是保证访问顺序。

1

2

3

4

5

6

7

8

public V get (Object key)

Node<K,V> e;

if ((e = getNode(hash(key), key)) == null )

return null ;

if (accessOrder)

afterNodeAccess(e);

return e.value;

}

还记得这些afterNodeXXXX命名格式的函数吗?我们之前已经在HashMap中见识过了,这些函数在HashMap中只是一个空实现,是专门用来让LinkedHashMap重写实现的hook函数。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

void afterNodeRemoval (Node<K,V> e)

LinkedHashMap.Entry<K,V> p =

(LinkedHashMap.Entry<K,V>)e, b = p.before, a = p.after;

p.before = p.after = null ;

if (b == null )

head = a;

else

b.after = a;

if (a == null )

tail = b;

else

a.before = b;

}

void afterNodeInsertion (boolean evict)

LinkedHashMap.Entry<K,V> first;

if (evict && (first = head) != null && removeEldestEntry(first)) {

K key = first.key;

removeNode(hash(key), key, null , false , true );

}

}

void afterNodeAccess (Node<K,V> e)

LinkedHashMap.Entry<K,V> last;

if (accessOrder && (last = tail) != e) {

LinkedHashMap.Entry<K,V> p =

(LinkedHashMap.Entry<K,V>)e, b = p.before, a = p.after;

p.after = null ;

if (b == null )

head = a;

else

b.after = a;

if (a != null )

a.before = b;

else

last = b;

if (last == null )

head = p;

else {

p.before = last;

last.after = p;

}

tail = p;

++modCount;

}

}

注意removeEldestEntry()默认永远返回false,这时它的行为与普通的Map无异。如果你把removeEldestEntry()重写为永远返回true,那么就有可能使LinkedHashMap处于一个永远为空的状态(每次put()或者putAll()都会删除头节点)。

一个比较合理的实现示例:

1

2

3

protected boolean removeEldestEntry (Map.Entry eldest)

return size() > MAX_SIZE;

}

LinkedHashMap重写了newNode()等函数,以初始化或连接节点到它内部的双向链表:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

private void linkNodeLast (LinkedHashMap.Entry<K,V> p)

LinkedHashMap.Entry<K,V> last = tail;

tail = p;

if (last == null )

head = p;

else {

p.before = last;

last.after = p;

}

}

private void transferLinks (LinkedHashMap.Entry<K,V> src,

LinkedHashMap.Entry<K,V> dst) {

LinkedHashMap.Entry<K,V> b = dst.before = src.before;

LinkedHashMap.Entry<K,V> a = dst.after = src.after;

if (b == null )

head = dst;

else

b.after = dst;

if (a == null )

tail = dst;

else

a.before = dst;

}

Node<K,V> newNode (int hash, K key, V value, Node<K,V> e) {

LinkedHashMap.Entry<K,V> p =

new LinkedHashMap.Entry<K,V>(hash, key, value, e);

linkNodeLast(p);

return p;

}

Node<K,V> replacementNode (Node<K,V> p, Node<K,V> next) {

LinkedHashMap.Entry<K,V> q = (LinkedHashMap.Entry<K,V>)p;

LinkedHashMap.Entry<K,V> t =

new LinkedHashMap.Entry<K,V>(q.hash, q.key, q.value, next);

transferLinks(q, t);

return t;

}

TreeNode<K,V> newTreeNode (int hash, K key, V value, Node<K,V> next) {

TreeNode<K,V> p = new TreeNode<K,V>(hash, key, value, next);

linkNodeLast(p);

return p;

}

TreeNode<K,V> replacementTreeNode (Node<K,V> p, Node<K,V> next) {

LinkedHashMap.Entry<K,V> q = (LinkedHashMap.Entry<K,V>)p;

TreeNode<K,V> t = new TreeNode<K,V>(q.hash, q.key, q.value, next);

transferLinks(q, t);

return t;

}

遍历LinkedHashMap所需要的时间与Entry数量成正比,这是因为迭代器直接对双向链表进行迭代,而链表中只会含有Entry节点。迭代的顺序是从头节点开始一直到尾节点,插入操作会将新节点链接到尾部,所以保证了插入顺序,而访问顺序会通过afterNodeAccess()来保证,访问次数越多的节点越接近尾部。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

abstract class LinkedHashIterator

LinkedHashMap.Entry<K,V> next;

LinkedHashMap.Entry<K,V> current;

int expectedModCount;

LinkedHashIterator() {

next = head;

expectedModCount = modCount;

current = null ;

}

public final boolean hasNext ()

return next != null ;

}

final LinkedHashMap.Entry<K,V> nextNode () {

LinkedHashMap.Entry<K,V> e = next;

if (modCount != expectedModCount)

throw new ConcurrentModificationException();

if (e == null )

throw new NoSuchElementException();

current = e;

next = e.after;

return e;

}

public final void remove ()

Node<K,V> p = current;

if (p == null )

throw new IllegalStateException();

if (modCount != expectedModCount)

throw new ConcurrentModificationException();

current = null ;

K key = p.key;

removeNode(hash(key), key, null , false , false );

expectedModCount = modCount;

}

}

final class LinkedKeyIterator extends LinkedHashIterator

implements Iterator <K > {

public final K next () return nextNode().getKey(); }

}

final class LinkedValueIterator extends LinkedHashIterator

implements Iterator <V > {

public final V next () return nextNode().value; }

}

final class LinkedEntryIterator extends LinkedHashIterator

implements Iterator <Map .Entry <K ,V >> {

public final Map.Entry<K,V> next () { return nextNode(); }

}

ConcurrentHashMap 我们上述所讲的Map都是非线程安全的,这意味着不应该在多个线程中对这些Map进行修改操作,轻则会产生数据不一致的问题,甚至还会因为并发插入元素而导致链表成环(插入会触发扩容,而扩容操作需要将原数组中的元素rehash到新数组,这时并发操作就有可能产生链表的循环引用从而成环),这样在查找时就会发生死循环,影响到整个应用程序。

Collections.synchronizedMap(Map<K,V> m)可以将一个Map转换成线程安全的实现,其实也就是通过一个包装类,然后把所有功能都委托给传入的Map实现,而且包装类是基于synchronized关键字来保证线程安全的(时代的眼泪Hashtable也是基于synchronized关键字),底层使用的是互斥锁(同一时间内只能由持有锁的线程访问,其他竞争线程进入睡眠状态),性能与吞吐量差强人意。

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

public static <K,V> Map<K,V> synchronizedMap (Map<K,V> m) {

return new SynchronizedMap<>(m);

}

private static class SynchronizedMap <K ,V >

implements Map <K ,V >, Serializable {

private static final long serialVersionUID = 1978198479659022715L ;